Recurrent Neural Network

Giới thiệu

Recurrent Neural Network là một loại mạng nơ-ron được thiết kế để xử lý dữ liệu dạng chuỗi, như chuỗi thời gian, ngôn ngữ, hoặc khung hình video. Khác với mạng nơ-ron truyền thống, RNN có các kết nối vòng lặp (loop back) cho phép nó “ghi nhớ” các đầu vào trước đó. Điều này giúp RNN rất phù hợp cho các bài toán như mô hình ngôn ngữ, nhận diện giọng nói, và dự đoán chuỗi.

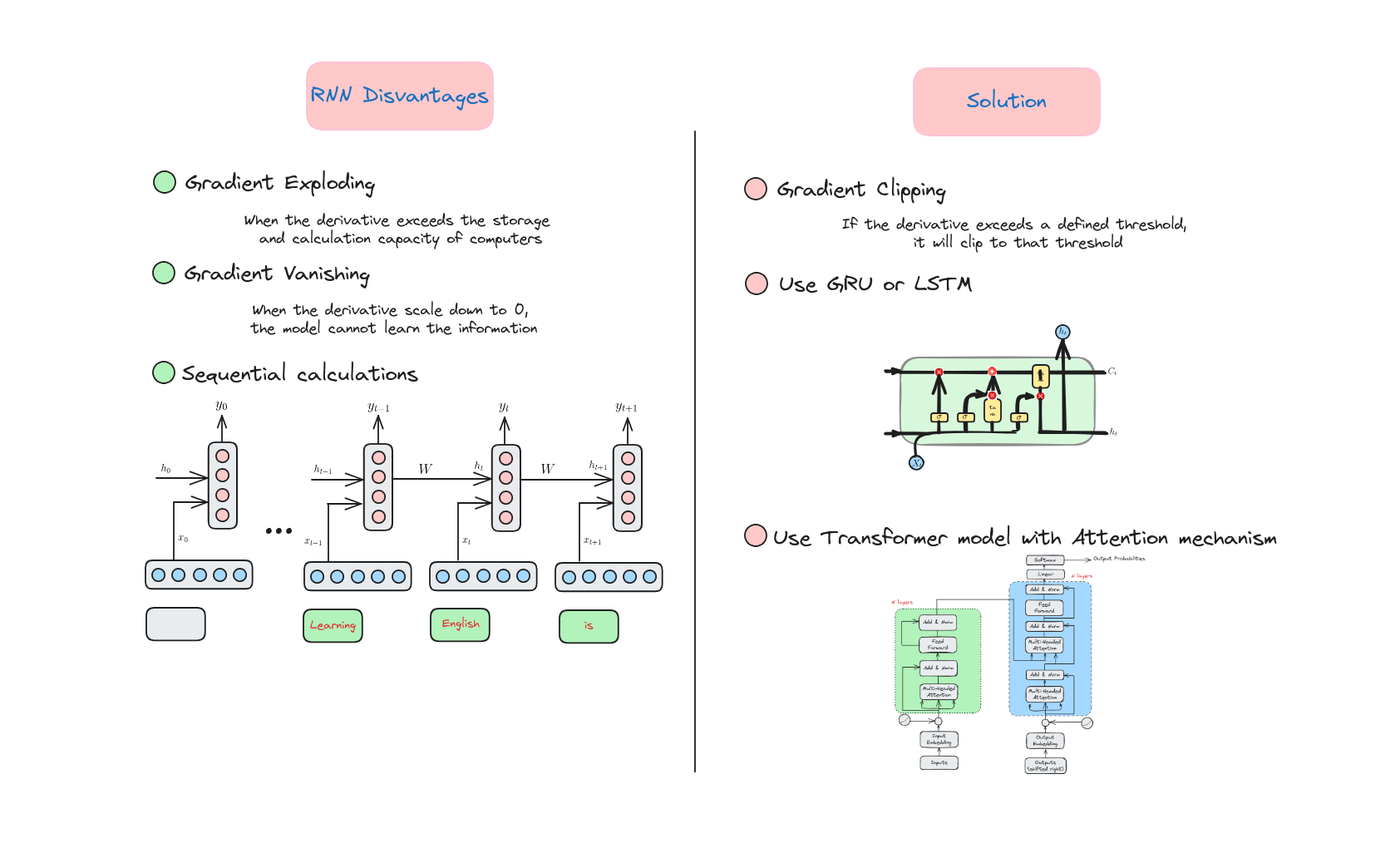

Các biến thể như LSTM và GRU đã được phát triển để giải quyết các thách thức khi huấn luyện RNN, đặc biệt là việc ghi nhớ các phụ thuộc dài hạn (long-term dependencies) trong dữ liệu.

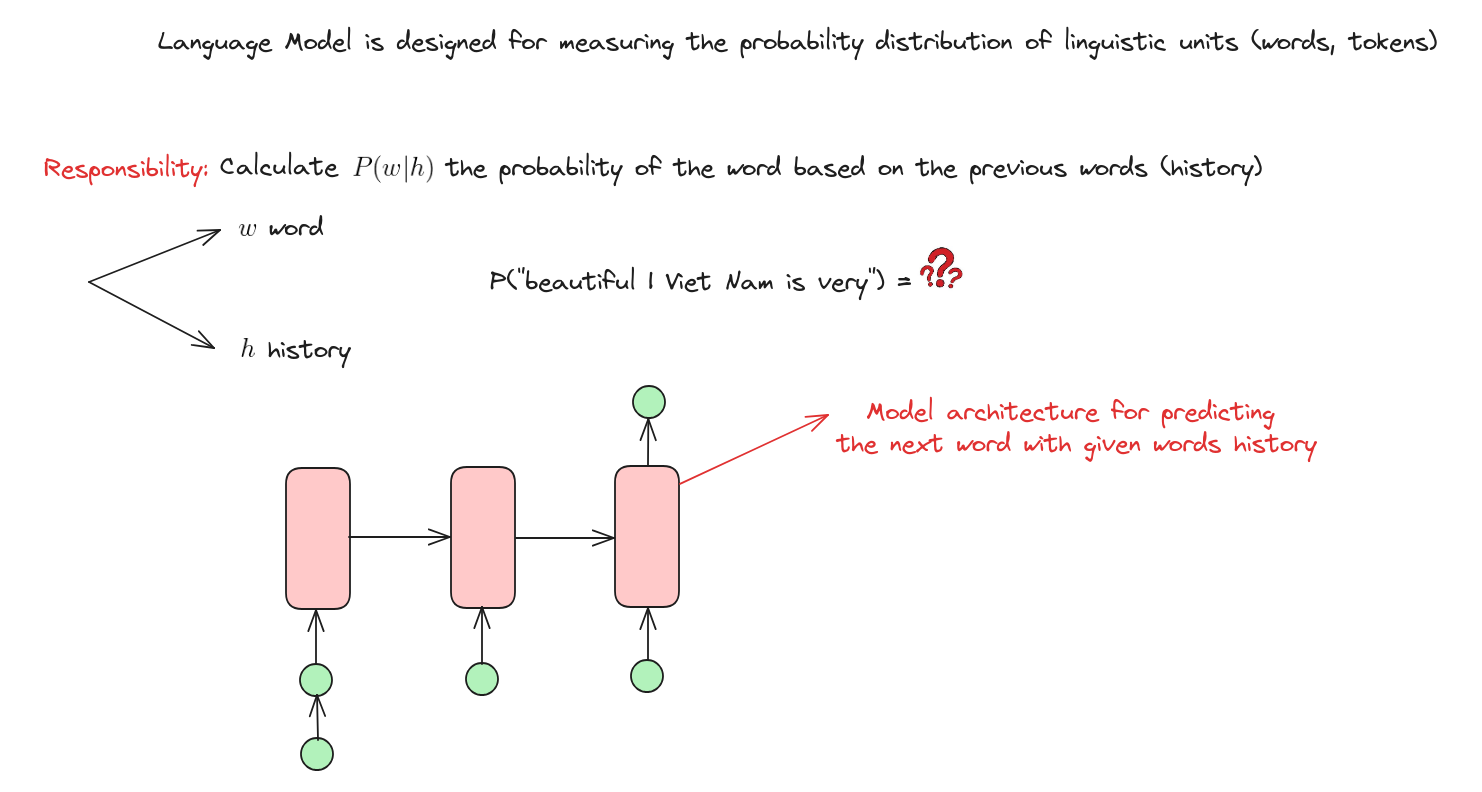

Mô hình ngôn ngữ

Mô hình ngôn ngữ là một hệ thống trí tuệ nhân tạo được thiết kế để hiểu, sinh hoặc dự đoán ngôn ngữ con người dựa trên các mẫu và cấu trúc học được từ lượng lớn dữ liệu văn bản. Nó giống như một “nhà ngôn ngữ học ảo” xử lý và sinh văn bản, hỗ trợ các tác vụ như dịch, tóm tắt, hội thoại…

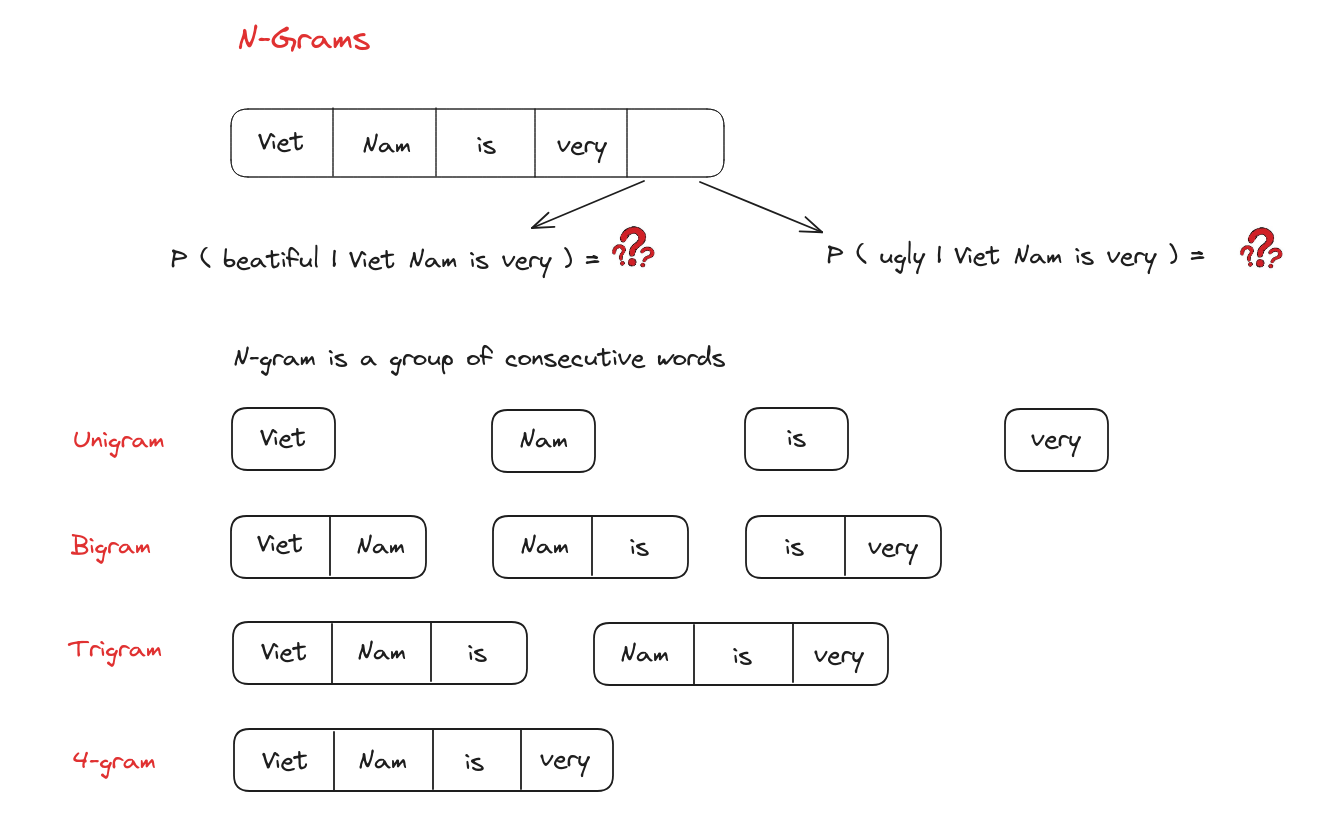

Mô hình ngôn ngữ N-Grams

N-Grams

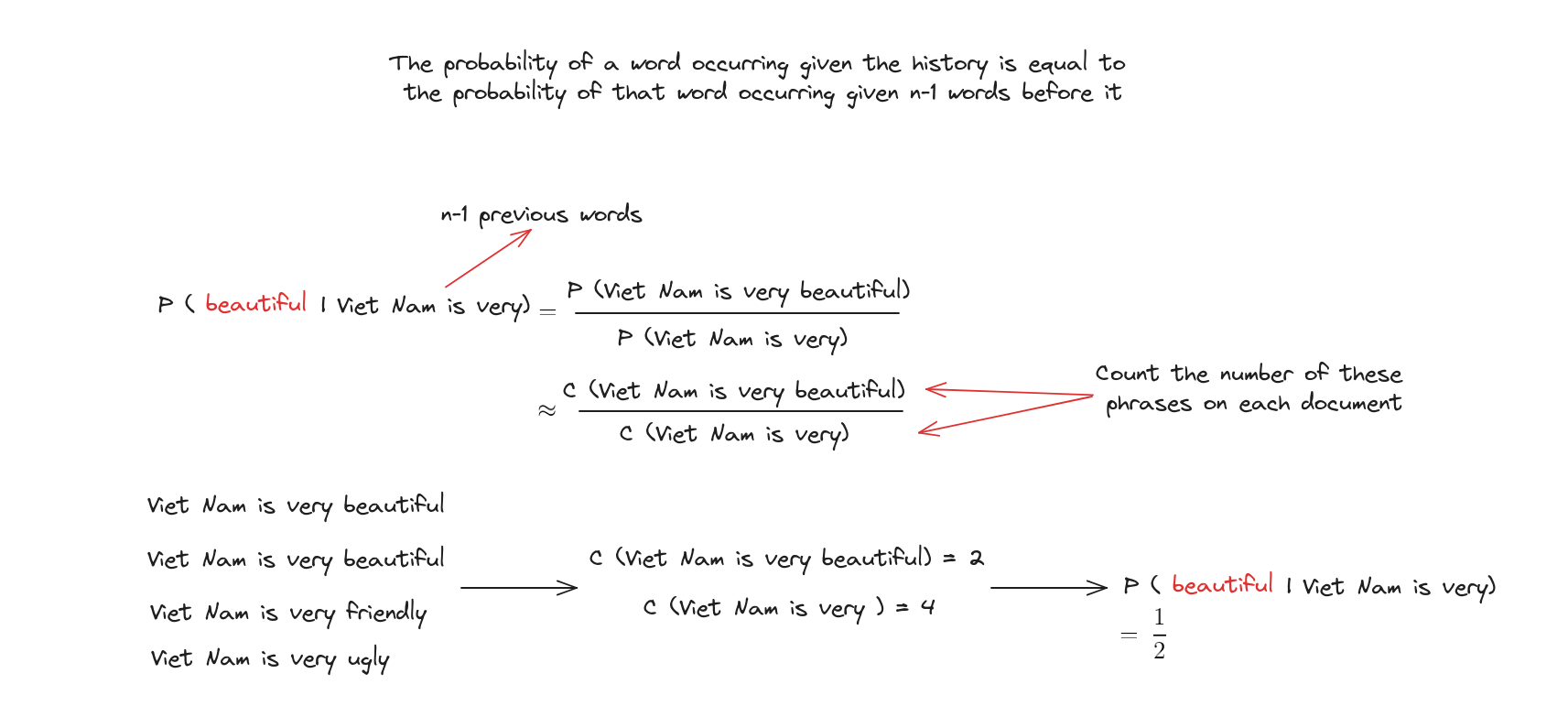

Mô hình N-Grams

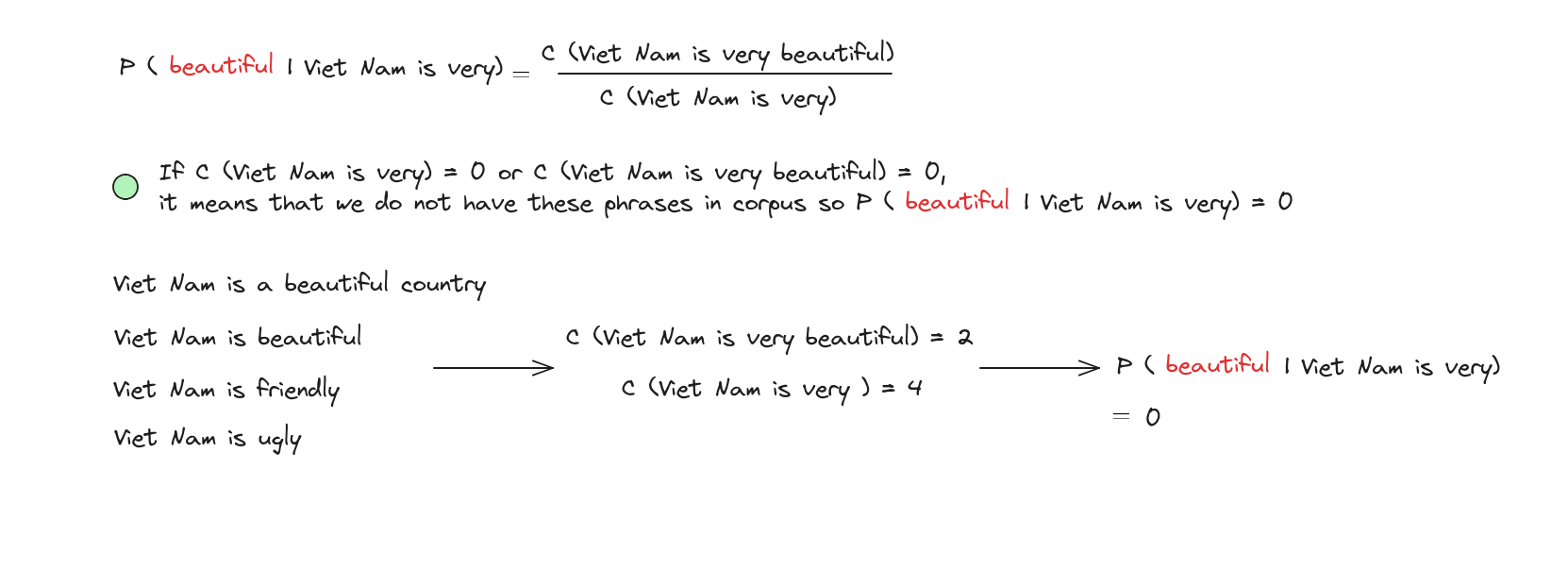

Vấn đề của N-Grams

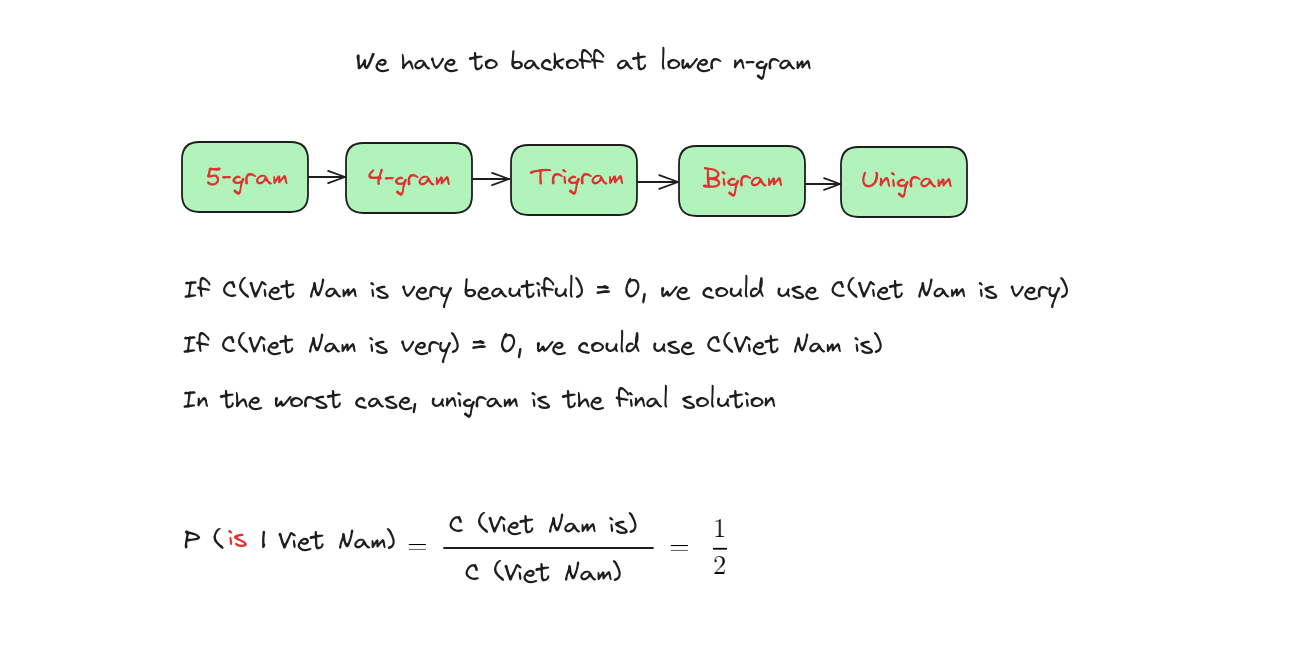

Giải pháp cho N-Grams

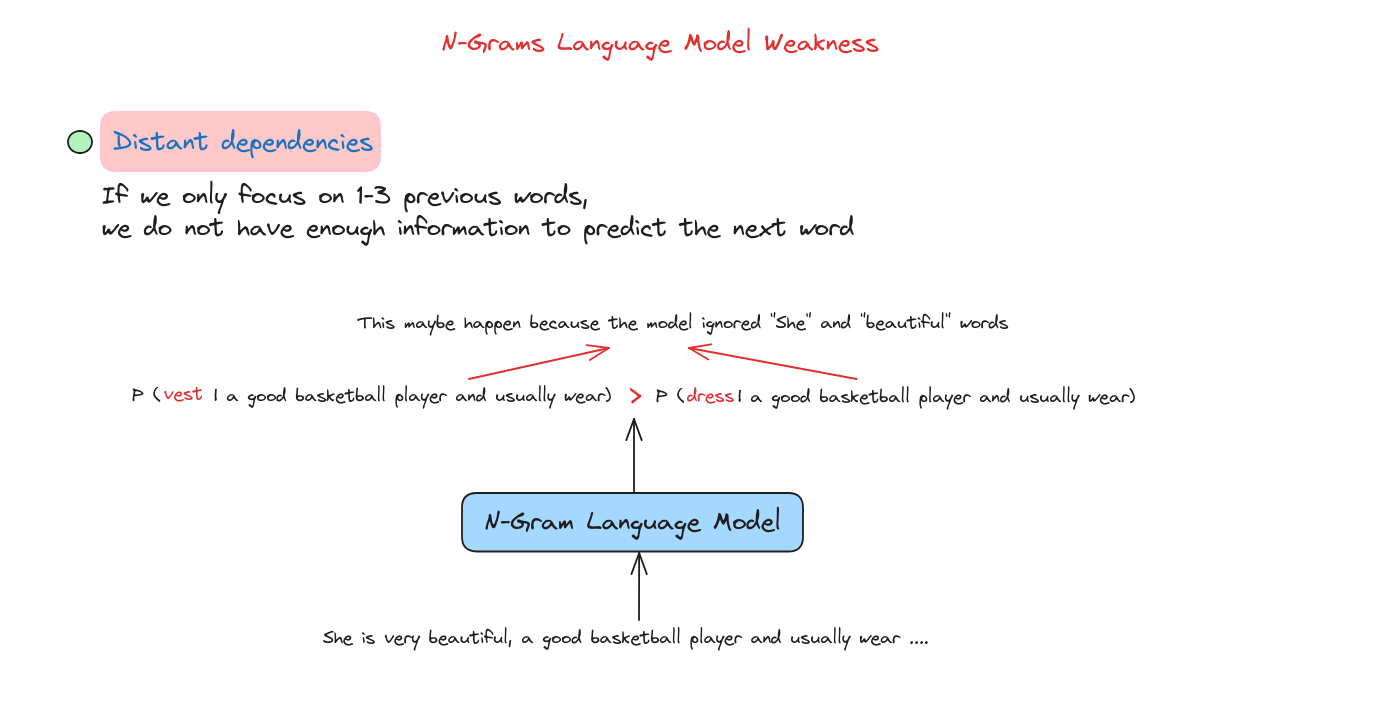

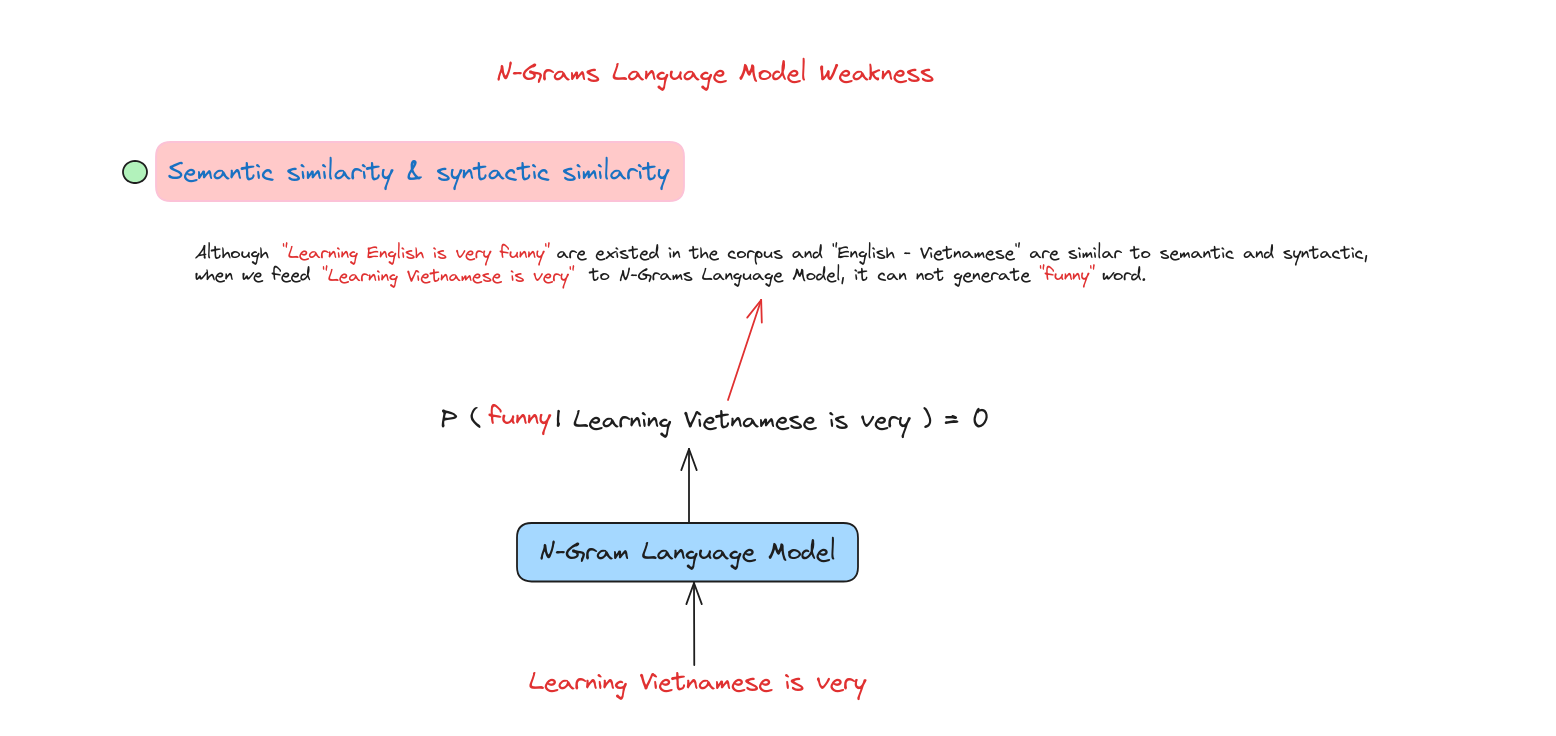

Điểm yếu của N-Grams

-> Chúng ta cần một mô hình ngôn ngữ mới để giải quyết các vấn đề này.

Mô hình ngôn ngữ dùng mạng nơ-ron

Neural language model là mô hình ngôn ngữ sử dụng mạng nơ-ron nhân tạo, lấy cảm hứng từ cấu trúc não bộ con người, để xử lý và sinh ngôn ngữ. Khi được huấn luyện trên tập dữ liệu lớn, nó học được các mẫu và mối quan hệ trong ngôn ngữ, cho phép thực hiện các tác vụ như sinh văn bản, dịch, phân tích cảm xúc với độ chính xác cao.

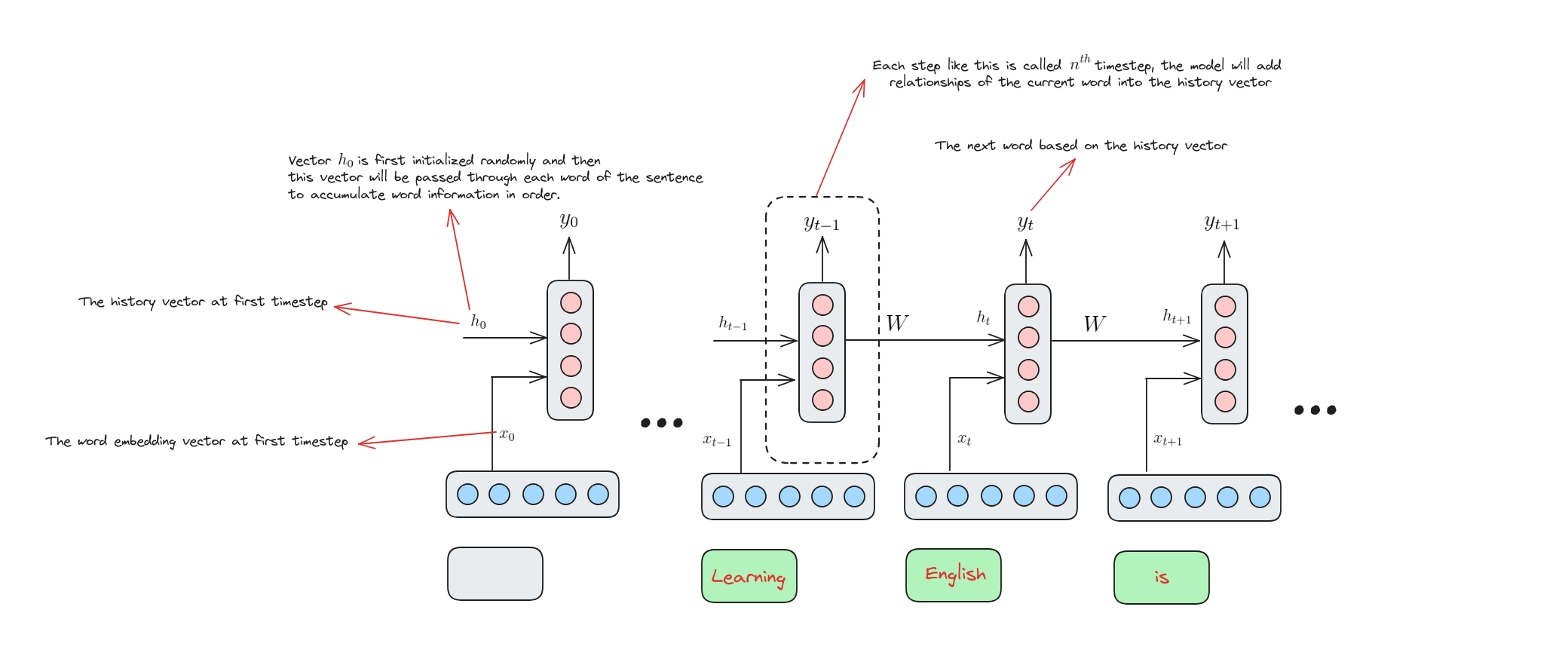

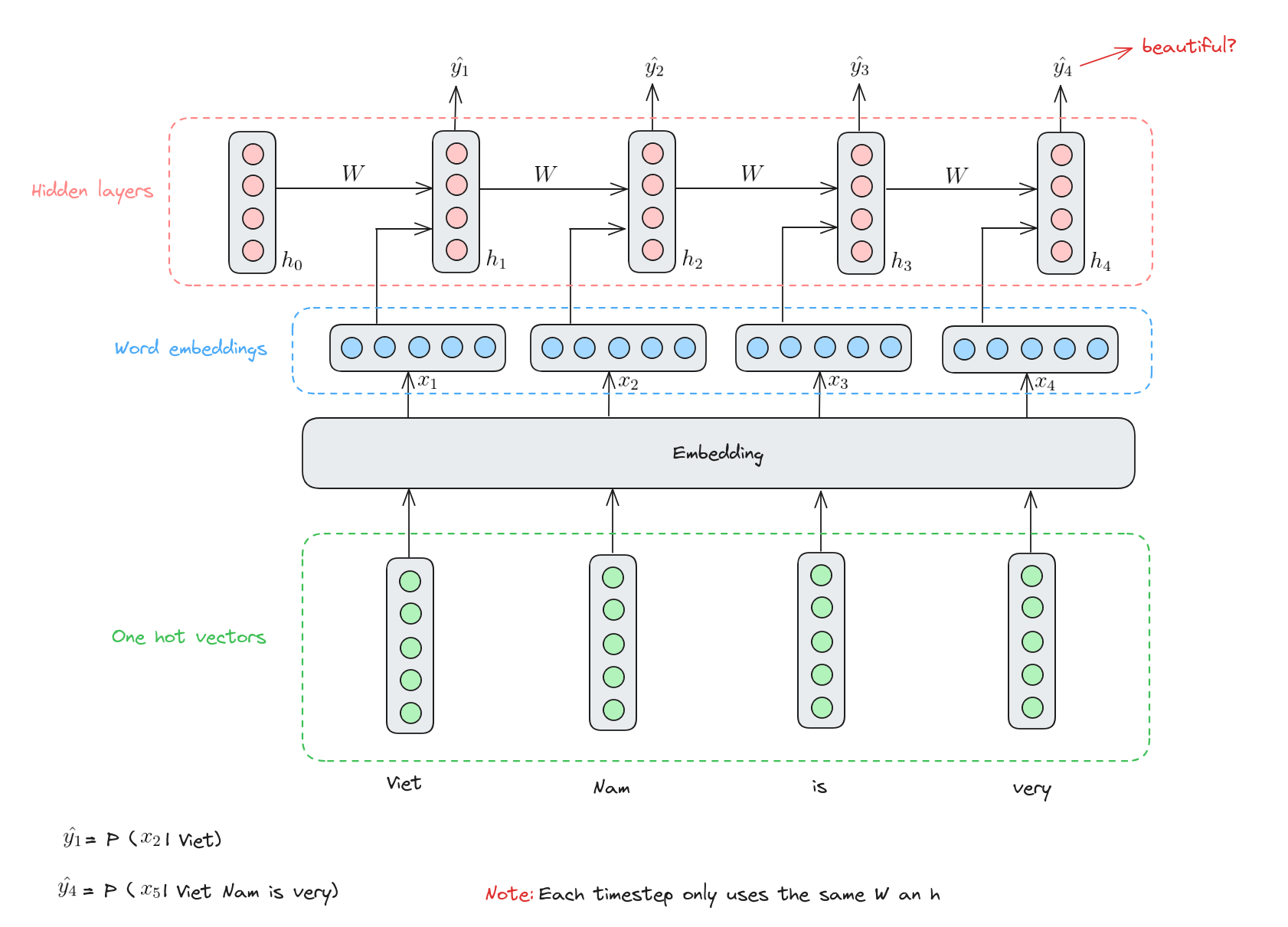

Các thành phần của RNN

Mô hình ngôn ngữ dựa trên RNN

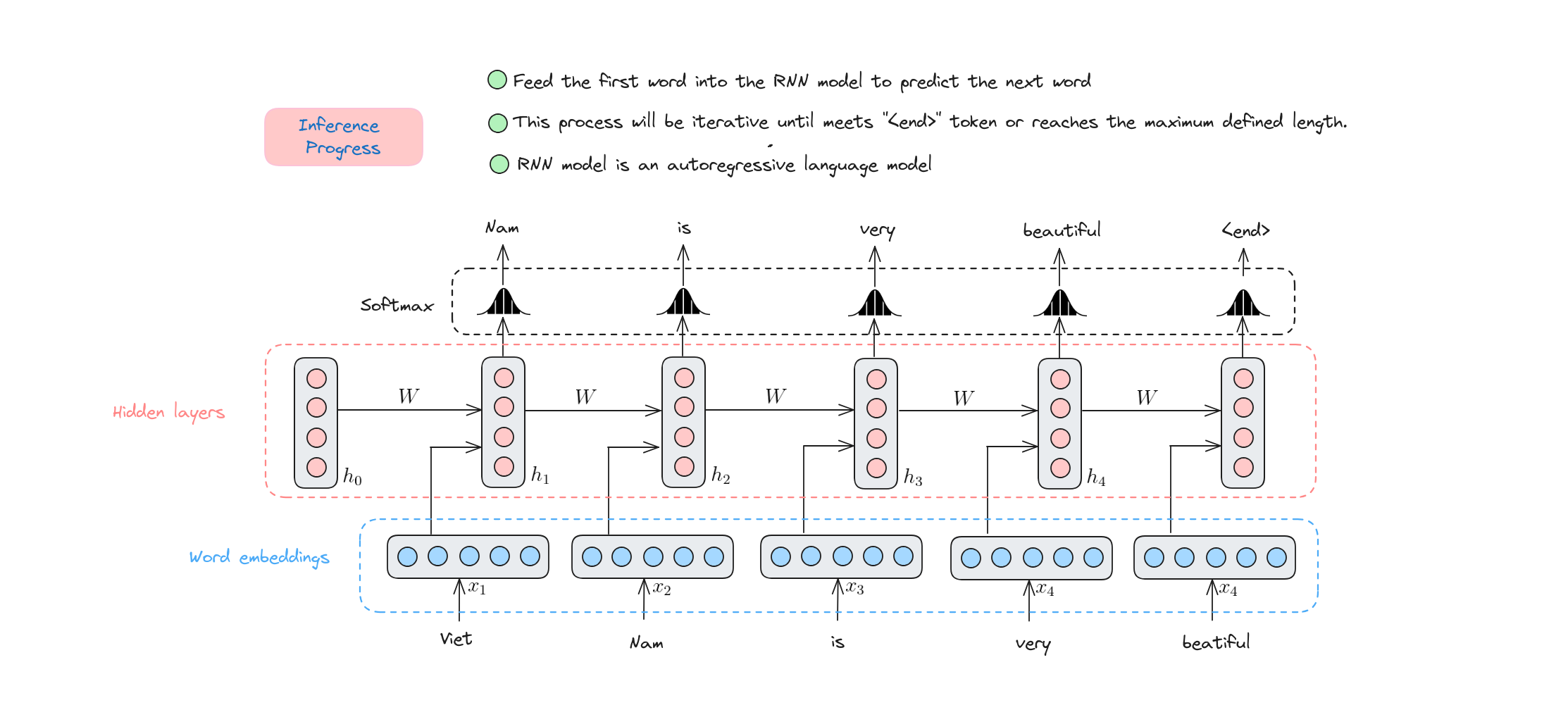

Quá trình suy luận của RNN

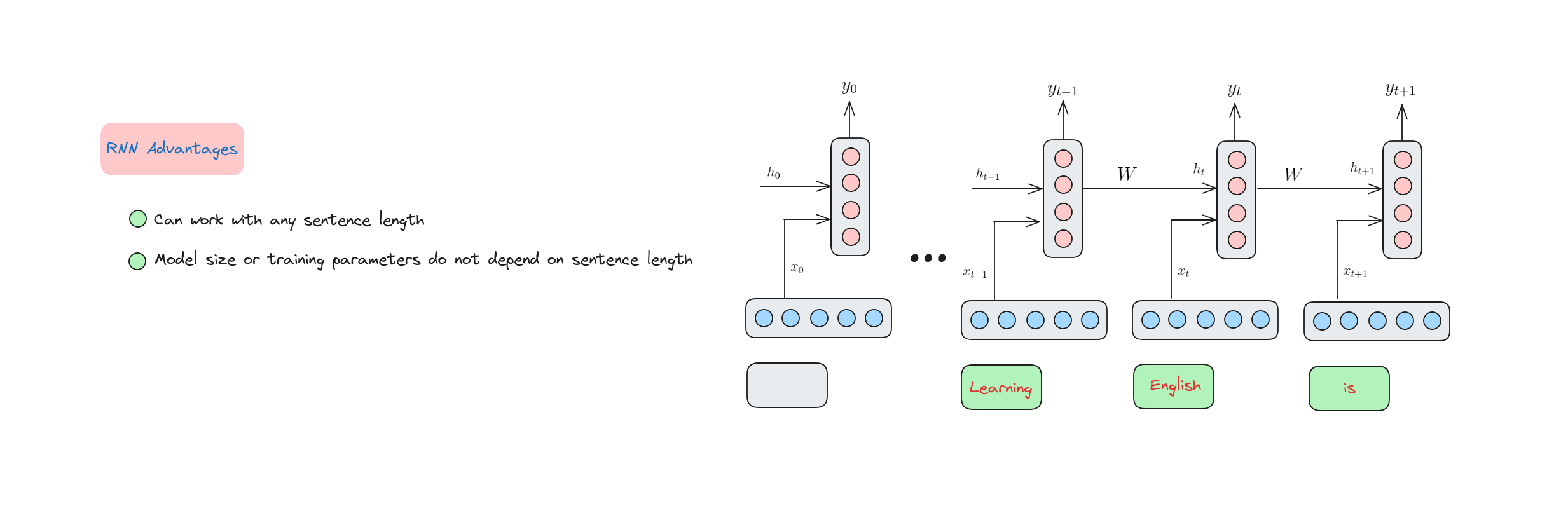

Ưu điểm của RNN

Vấn đề và giải pháp của RNN

Tài liệu tham khảo

- A. Amidi and S. Amidi, “CS 230 - Recurrent Neural Networks Cheatsheet,” Stanford.edu, 2019. https://stanford.edu/~shervine/teaching/cs-230/cheatsheet-recurrent-neural-networks

- “Recurrent Neural Network Tutorial (RNN),” www.datacamp.com. https://www.datacamp.com/tutorial/tutorial-for-recurrent-neural-network